IA en Ciberseguridad: Por Qué el Humano en el Bucle Es la Arquitectura, No un Cuello de Botella

Solo el 2.4% de la actividad de agentes IA ocurre en ciberseguridad. Por que el humano en el bucle sigue siendo la capa mas critica.

- Ai

- Industry

- Career

- Security Operations

- Thought Leadership

TL;DR

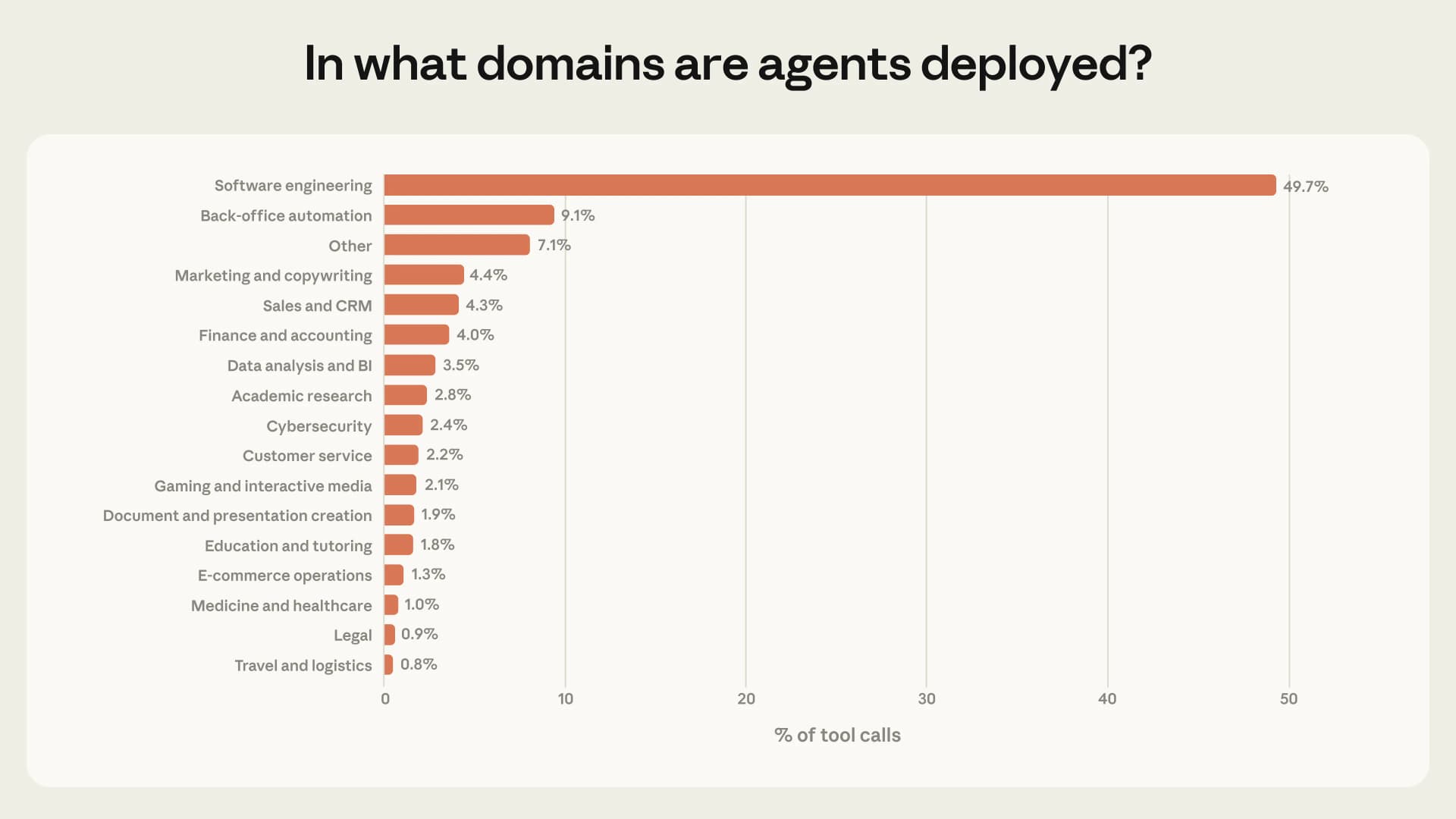

La investigación de Anthropic en 2026 sobre el despliegue de agentes de IA revela que la ciberseguridad representa solo el 2.4% de todas las llamadas a herramientas de agentes, mientras que la ingeniería de software domina con el 49.7%. Esto no es un fallo de adopción. Es una señal de madurez. La seguridad es un dominio adversarial donde el juicio humano conlleva responsabilidad, las señales se manipulan deliberadamente, y la diferencia entre una falsa alarma y una intrusión de un estado nación depende de una experiencia que no puede serializarse y entregarse a una máquina. El humano en el bucle no es una limitación. Es la arquitectura.

El Gráfico Que Debería Sorprenderte

Hay un gráfico circulando de la última investigación de Anthropic sobre cómo se están desplegando realmente los agentes de IA en distintas industrias. La ingeniería de software está en la cima. El 49.7% de todas las llamadas a herramientas de agentes. Casi la mitad. Debajo, la lista cae rápido: automatización de back office con el 9.1%, marketing con el 4.4%, análisis de datos con el 3.5%.

Y luego, en algún lugar cerca del final, casi fácil de pasar por alto: Ciberseguridad. 2.4%.

Ese número debería sorprenderte. No porque la ciberseguridad sea irrelevante. Es posiblemente el dominio más importante de la lista. Sino porque la brecha entre cuánto se usa la IA en seguridad y cuánto se habla de IA en seguridad es enorme. Cada conferencia, cada pitch de proveedor, cada publicación en LinkedIn promete detección de amenazas impulsada por IA, respuesta a incidentes autónoma, defensa a velocidad de máquina.

Y sin embargo, cuando miras dónde están trabajando realmente los agentes, la ciberseguridad apenas aparece.

Hay una razón para ello. Y la razón es más interesante que el número.

Por Qué la Ciberseguridad Resiste la Automatización con IA

La ciberseguridad no es como la ingeniería de software.

En ingeniería de software, el ciclo de retroalimentación es limpio. Escribes código. Compila o no compila. Los tests pasan o fallan. El resultado es lo suficientemente determinista como para que un agente pueda iterar de forma autónoma: escribir, probar, corregir, repetir. Por eso casi la mitad de toda la actividad de agentes vive ahí. El ciclo es corto. La señal es clara.

La seguridad no funciona así.

En seguridad, la señal es adversarial. Alguien está activamente intentando que los datos sean engañosos. El trabajo completo del atacante es hacer que su actividad parezca tráfico normal, acceso legítimo, una entrada rutinaria en el log.

Un agente de IA puede escanear un millón de entradas de log en segundos. Eso es genuinamente útil. Pero decidir si la anomalía en la entrada 847,321 es un servicio mal configurado, un caso extremo rutinario, o el primer indicador de una intrusión de un estado nación requiere algo que los modelos no tienen: juicio situado.

El tipo de juicio que viene de un analista humano que ha visto tres incidentes que empezaron exactamente así. Que sabe que ese segmento particular de red fue reestructurado el martes pasado. Que recuerda que el mismo rango de IP apareció en un briefing de amenazas hace dos semanas. Y que tiene la autoridad institucional para escalar o descartar basándose en una síntesis de contexto que ningún modelo puede acceder, porque vive en la experiencia del analista, no en los datos.

Piensa en lo que ocurre dentro de un Centro de Operaciones de Seguridad a las 3 de la madrugada. Una plataforma SIEM marca un patrón de movimiento lateral entre dos hosts internos. La capa de triaje de IA lo clasifica como severidad media basándose en líneas base históricas. Un analista junior seguiría el playbook: aislar, escalar, documentar. Pero la analista senior de turno reconoce esos dos hosts. Uno pertenece al equipo de infraestructura que está ejecutando una migración autorizada anunciada en un canal de Slack hace tres días. El otro es un servidor de staging que siempre genera tráfico anómalo durante las ventanas de despliegue. Ella cierra el ticket en cuarenta segundos. Ningún playbook cubría esto. Ningún modelo tenía acceso al mensaje de Slack, al calendario de migración, ni a la memoria institucional de cómo luce lo "normal" para esas dos máquinas específicas durante esa semana específica.

Eso es juicio situado. Y es la razón por la que la ciberseguridad resiste el tipo de automatización de extremo a extremo que funciona tan bien para compilar código o ejecutar tests de regresión.

El Centinela: Una Antropología de la Vigilancia en Ciberseguridad

Toda sociedad humana que ha existido ha tenido vigilantes. Centinelas. Personas cuyo rol no era construir los muros ni labrar los campos, sino pararse en el borde del asentamiento y mirar hacia la oscuridad.

Este rol nunca fue puramente técnico. El centinela no solo observaba. El centinela interpretaba. Un movimiento en la hierba podía ser el viento, un animal o un enemigo acercándose. La diferencia entre esas tres interpretaciones no era cuestión de mejores sensores. Era cuestión de conocimiento acumulado sobre ese campo específico, esa estación, ese patrón de incursiones, el comportamiento esperado de ese enemigo. El valor del centinela no estaba en su vista. Estaba en su juicio, forjado al vivir dentro de un contexto que ningún extraño, por más perceptivo que fuera, podría replicar solo con datos.

Cuando automatizamos la vigilancia, no obtenemos un mejor centinela. Obtenemos un sensor más rápido. No son lo mismo.

Los analistas SOC son los centinelas del mundo conectado. Y lo que los datos de Anthropic están confirmando silenciosamente es algo que los antropólogos han entendido durante milenios: el rol de vigilancia resiste la mecanización porque no es fundamentalmente una tarea de percepción. Es una tarea de construcción de significado. El centinela no solo ve. El centinela decide qué significa lo que ve.

Y esa decisión se nutre de capas de conocimiento cultural, institucional y experiencial que no pueden extraerse, serializarse y entregarse a una máquina.

El Problema de Responsabilidad con la IA Autónoma en Seguridad

Hay otra dimensión de esto que la narrativa de "IA en todas partes" ignora constantemente.

Cuando una decisión de seguridad es incorrecta, alguien responde por ella. Si una amenaza se descarta y se convierte en una brecha de datos, hay una investigación. Hay una línea temporal. Hay un humano cuyo juicio se revisa, se cuestiona y, si es necesario, se le exige responsabilidad. Esto no es un error del sistema. Así es como funciona la gobernanza de seguridad. La cadena de responsabilidad es lo que hace que todo el sistema funcione.

Elimina al humano del bucle y no solo pierdes juicio. Pierdes responsabilidad. Y un sistema de seguridad sin responsabilidad no es un sistema de seguridad. Es un generador de riesgos legales.

Toda sociedad que ha lidiado con decisiones de alto impacto, desde consejos tribales hasta tribunales modernos, ha entendido que el peso de una decisión debe recaer en una persona. No porque las personas sean infalibles, sino porque el contrato social de la responsabilidad es lo que le da legitimidad a la decisión. Un juez que toma una decisión errónea puede ser apelado. Un algoritmo que toma una decisión errónea solo puede ser parcheado. No son equivalentes. Uno es justicia. El otro es mantenimiento.

Cómo las Organizaciones Realmente Despliegan la IA en Seguridad

Antes de descartar ese 2.4% como la historia completa, vale la pena entender qué está ocurriendo dentro de las organizaciones que sí están usando IA en su stack de seguridad.

Los números no son pequeños. En 2026, el 77% de las organizaciones reportan usar IA generativa o modelos de lenguaje en algún punto de sus operaciones de seguridad. Y el 67% han desplegado alguna forma de IA agéntica para tareas de seguridad autónomas o semi-autónomas. La tecnología está presente. La pregunta es cómo se está gobernando.

La respuesta es reveladora: el 70% de las organizaciones operan un modelo de humano en el bucle. La IA recomienda. Una persona aprueba. Solo el 14% permite que la IA tome acciones de remediación independientes sin supervisión humana. Las organizaciones restantes se ubican en algún punto intermedio, con distintos niveles de automatización controlados por puntos de verificación humanos.

Esto no es timidez. Es disciplina de ingeniería. Las organizaciones automatizan donde la precisión es alta y las consecuencias están contenidas. Bloqueo automatizado de firmas de malware conocidas. Cuarentena automatizada de correos de phishing que coinciden con patrones establecidos. Despliegue automatizado de parches para vulnerabilidades de bajo riesgo. Estas son las tareas donde el ciclo de retroalimentación es lo suficientemente corto para que las máquinas operen de forma independiente.

Pero en el momento en que una decisión toca sistemas críticos, implicaciones legales o datos de amenazas ambiguos, el humano vuelve a intervenir. Decisiones de contención que afectan infraestructura de producción. Revocaciones de acceso para cuentas privilegiadas. Llamadas de escalamiento que activan requisitos de notificación regulatoria. Estos son los momentos donde el costo de una decisión automatizada incorrecta supera el costo de esperar treinta segundos a que un humano la revise.

La industria no ha rechazado la IA. Ha colocado a la IA exactamente donde pertenece: como la capa más rápida en una arquitectura de defensa donde la capa más importante sigue siendo humana.

La Realidad del 84%: ¿Cuánta Gente Usa Realmente la IA?

Ahora alejemos la vista aún más.

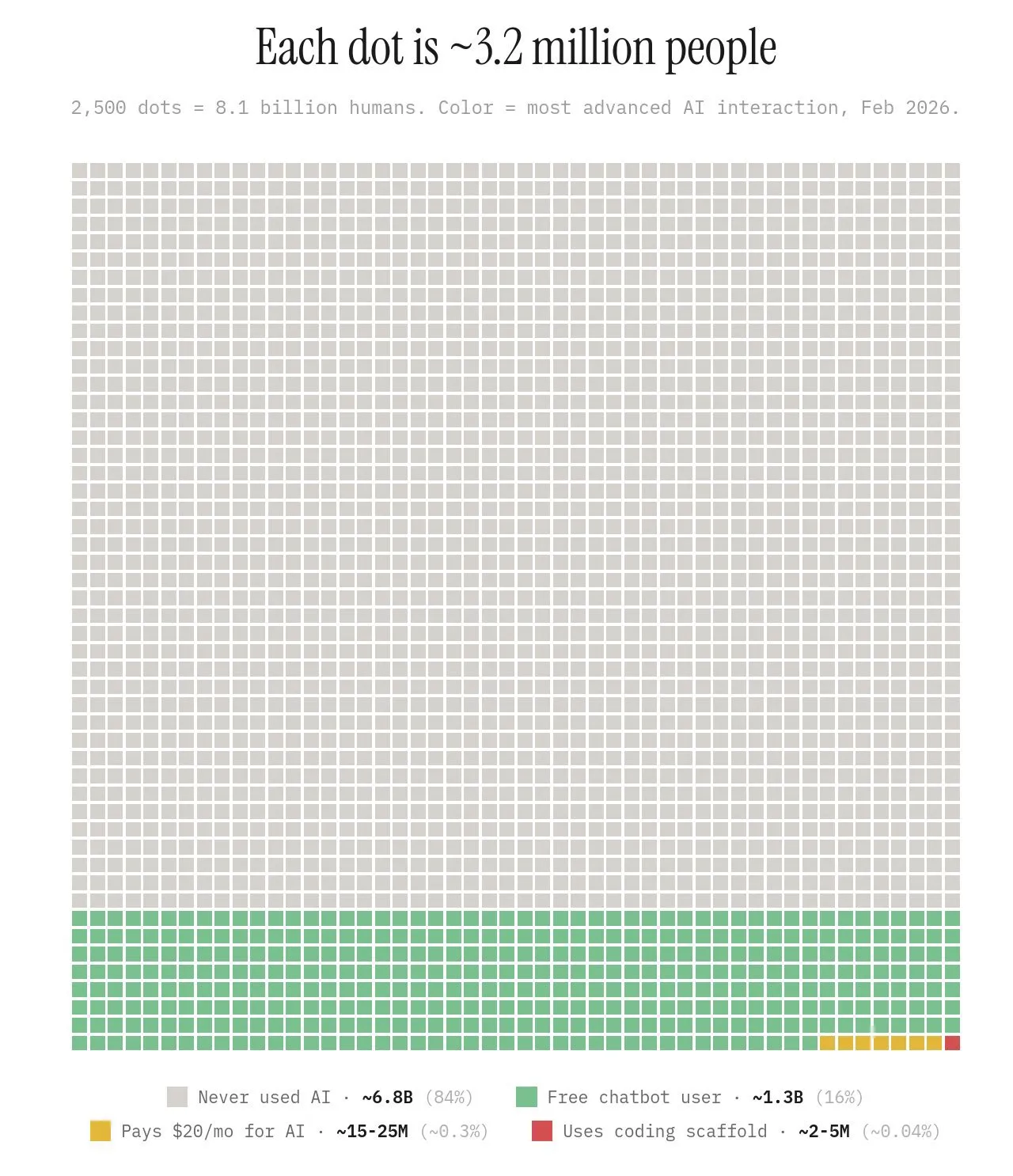

Hay otra visualización circulando, una matriz de puntos que representa a toda la población mundial. 8,100 millones de personas. Cada punto son 3.2 millones de humanos. Los colores cuentan la historia:

- El 84% nunca ha usado IA en absoluto. 6,800 millones de personas que nunca han escrito un prompt.

- El 16% son usuarios gratuitos de chatbots.

- Aproximadamente el 0.3% paga por IA.

- Aproximadamente el 0.04%, entre 2 y 5 millones de personas en todo el planeta, usa scaffolds de programación.

Toda la conversación global sobre la IA transformándolo todo está impulsada por la experiencia de menos del 1% de la población mundial. Los profesionales de seguridad desplegando agentes de IA, los ingenieros construyendo defensas automatizadas, los analistas cuyos flujos de trabajo han sido reestructurados, son un error de redondeo en la historia humana.

Esto no es un argumento contra la importancia de la IA. Es un argumento a favor de la proporción. Cuando alguien dice "la IA está cambiando la ciberseguridad", está describiendo un fenómeno que afecta a una porción ínfima de la humanidad, discutido por una porción aún más pequeña, y desplegado por una porción más pequeña todavía. La urgencia puede ser real. La escala del impacto actual no es lo que la narrativa sugiere.

A lo largo de la historia, las tecnologías transformadoras siempre han sido narradas por la pequeña minoría que las usa primero, creando una percepción de universalidad que no coincide con la realidad vivida por la mayoría de las personas. La imprenta estaba cambiándolo todo durante décadas antes de que la mayoría de los europeos hubieran sostenido un libro. La electricidad era el futuro mientras la mayor parte del mundo todavía cocinaba sobre fuego. Estamos viviendo dentro de esa misma distorsión ahora mismo, excepto que la velocidad de la narrativa ha superado la velocidad de la adopción por el margen más amplio en la historia registrada.

Lo Que la IA en Ciberseguridad Significa para Tu Carrera

Si estás estudiando ciberseguridad, o trabajando en ella, o considerándola, este es el panorama honesto.

La IA cambiará tus herramientas. El escaneo, el análisis de logs, el triaje inicial, la enumeración de vulnerabilidades. Todo esto se está automatizando y continuará haciéndolo. Si tu plan es pasar toda una carrera haciendo lo que un agente puede hacer en segundos, revisa el plan.

La IA no reemplazará tu rol. No porque la tecnología no pueda mejorar. Lo hará. Sino porque la naturaleza del problema adversarial significa que aquello contra lo que te defiendes también está usando IA. Esto crea una carrera armamentista donde el juicio humano no es un cuello de botella. Es el factor decisivo. El atacante tiene IA. El defensor tiene IA. La diferencia es el humano que decide qué hacer con lo que la IA le presenta.

Las habilidades que importan están cambiando. La revisión mecánica de logs está desapareciendo. El escaneo manual de vulnerabilidades ya desapareció. Lo que está creciendo es la demanda de profesionales que puedan interpretar hallazgos generados por IA, que puedan distinguir entre un sistema de IA que da falsas alarmas y un sistema de IA que ha encontrado algo genuinamente nuevo, que puedan diseñar las políticas que gobiernan lo que la IA puede hacer de forma autónoma y dónde deben permanecer las puertas humanas. La caza de amenazas, el liderazgo en respuesta a incidentes, la arquitectura de seguridad y la gobernanza de IA son hacia donde apuntan las trayectorias profesionales ahora.

Nuestra especie siempre ha necesitado a sus centinelas. Las herramientas que portan cambian con cada era. El rol no. La persona en el borde del asentamiento, mirando hacia la oscuridad, decidiendo qué significan las formas. Ese es un trabajo ancestral. También es el tuyo.

Aprende las herramientas. Usa los modelos. Automatiza lo que pueda automatizarse. Pero construye tu perfil alrededor de la parte que no puede serlo: el juicio, el contexto, la responsabilidad, la voluntad de pararte en la brecha entre lo que la máquina ve y lo que significa.

Ese es el trabajo. Las máquinas lo hacen más rápido. No lo hacen innecesario.

Nunca lo harán.

Fundador de Unihackers

Una década defendiendo aerolíneas, SOCs y organizaciones internacionales

Daute fundó Unihackers tras una década defendiendo aerolíneas, SOCs gestionados y organizaciones internacionales. Es Associate C|CISO y voz habitual sobre IA y ciberseguridad en medios internacionales. Silver Winner en los Cyber Security Excellence Awards 2021. Enseña como le habría gustado que le enseñasen a él: sin ruido, entrenando lo que los atacantes hacen de verdad y formando profesionales útiles desde el primer día.

Ver perfil¿Listo para iniciar tu carrera en ciberseguridad?

Únete a cientos de profesionales que han hecho la transición a la ciberseguridad con nuestro bootcamp práctico.