IA et cybersecurite : pourquoi l'humain dans la boucle est l'architecture, pas un goulet d'etranglement

Seulement 2,4 % de l'activite des agents IA concerne la cybersecurite. Pourquoi l'humain dans la boucle reste la couche la plus critique.

- Ai

- Industry

- Career

- Security Operations

- Thought Leadership

En resume

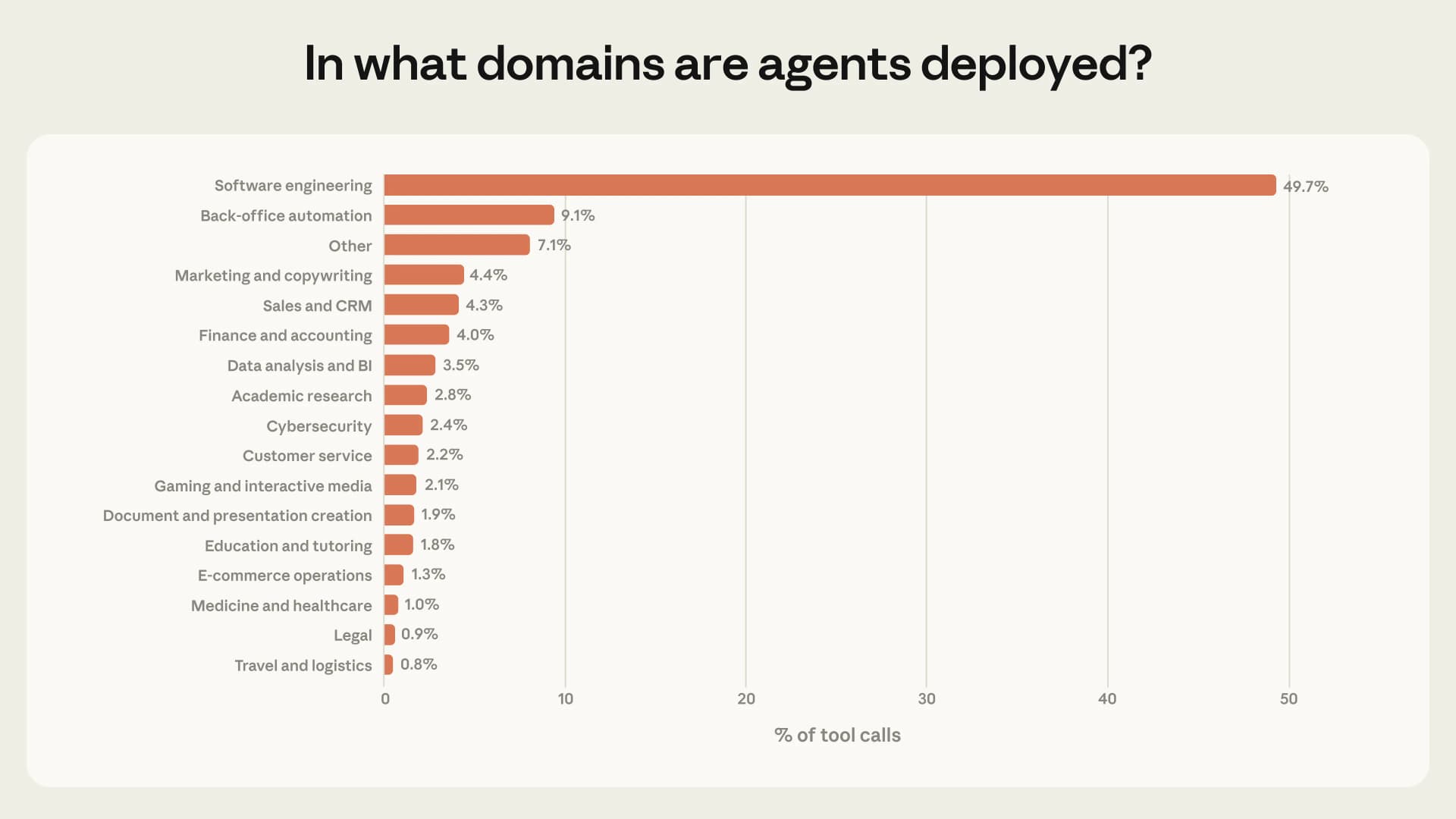

La recherche d'Anthropic de 2026 sur le deploiement des agents IA revele que la cybersecurite ne represente que 2,4 % de tous les appels d'outils par les agents, tandis que le genie logiciel domine a 49,7 %. Ce n'est pas un echec d'adoption. C'est un signal de maturite. La securite est un domaine adversarial ou le jugement humain porte la responsabilite, ou les signaux sont deliberement manipules, et ou la difference entre une fausse alerte et une intrusion etatique repose sur une experience que l'on ne peut ni serialiser ni confier a une machine. L'humain dans la boucle n'est pas une limitation. C'est l'architecture.

Le graphique qui devrait vous surprendre

Un graphique circule actuellement, issu de la derniere recherche d'Anthropic sur la facon dont les agents IA sont reellement deployes dans les differents secteurs. Le genie logiciel trone au sommet. 49,7 % de tous les appels d'outils par les agents. Pres de la moitie. En dessous, la liste chute rapidement : l'automatisation administrative a 9,1 %, le marketing a 4,4 %, l'analyse de donnees a 3,5 %.

Et puis, quelque part pres du bas, presque facile a manquer : Cybersecurite. 2,4 %.

Ce chiffre devrait vous surprendre. Non parce que la cybersecurite serait sans importance. C'est sans doute le domaine le plus consequent de la liste. Mais parce que l'ecart entre la facon dont l'IA est utilisee en securite et la facon dont on en parle en securite est colossal. Chaque conference, chaque presentation commerciale, chaque publication LinkedIn promet une detection des menaces pilotee par l'IA, une reponse aux incidents autonome, une defense a la vitesse de la machine.

Et pourtant, quand on observe ou les agents travaillent reellement, la cybersecurite apparait a peine.

Il y a une raison a cela. Et cette raison est plus interessante que le chiffre lui-meme.

Pourquoi la cybersecurite resiste a l'automatisation par l'IA

La cybersecurite n'est pas comme le genie logiciel.

En genie logiciel, la boucle de retroaction est nette. On ecrit du code. Il compile ou non. Les tests passent ou echouent. Le resultat est suffisamment deterministe pour qu'un agent puisse iterer de maniere autonome : ecrire, tester, corriger, recommencer. C'est pourquoi pres de la moitie de toute l'activite des agents se concentre la. La boucle est serree. Le signal est clair.

La securite ne fonctionne pas ainsi.

En securite, le signal est adversarial. Quelqu'un tente activement de rendre les donnees trompeuses. Le travail de l'attaquant consiste precisement a faire passer son activite pour du trafic normal, un acces legitime, une entree de log routiniere.

Un agent IA peut scanner un million d'entrees de logs en quelques secondes. C'est reellement utile. Mais determiner si l'anomalie de l'entree 847 321 est un service mal configure, un cas limite routinier, ou le premier indicateur d'une intrusion etatique exige quelque chose que les modeles ne possedent pas : un jugement contextualise.

Le genre de jugement qui vient d'un analyste humain ayant vu trois incidents qui ont commence exactement comme celui-ci. Qui sait que ce segment reseau particulier a ete restructure mardi dernier. Qui se souvient que la meme plage d'adresses IP est apparue dans un briefing de menaces il y a deux semaines. Et qui detient l'autorite institutionnelle d'escalader ou de rejeter, sur la base d'une synthese de contexte a laquelle aucun modele ne peut acceder, parce qu'elle reside dans l'experience de l'analyste, pas dans les donnees.

Imaginez ce qui se passe dans un Centre des Operations de Securite a 3 heures du matin. Une plateforme SIEM signale un schema de deplacement lateral entre deux hotes internes. La couche de triage IA lui attribue une severite moyenne sur la base de references historiques. Un analyste junior suivrait le playbook : isoler, escalader, documenter. Mais l'analyste senior de service reconnait ces deux machines. L'une appartient a l'equipe infrastructure qui effectue une migration autorisee, annoncee dans un canal Slack trois jours plus tot. L'autre est un serveur de staging qui genere toujours du trafic anormal pendant les fenetres de deploiement. Elle ferme le ticket en quarante secondes. Aucun playbook ne couvrait ce cas. Aucun modele n'avait acces au message Slack, au calendrier de migration, ni a la memoire institutionnelle de ce qui est "normal" pour ces deux machines specifiques pendant cette semaine precise.

C'est le jugement contextualise. Et c'est la raison pour laquelle la cybersecurite resiste au type d'automatisation de bout en bout qui fonctionne si bien pour compiler du code ou executer des tests de regression.

La sentinelle : une anthropologie de la vigilance en cybersecurite

Toute societe humaine ayant jamais existe a eu ses guetteurs. Ses sentinelles. Des personnes dont le role n'etait pas de construire les murs ni de labourer les champs, mais de se tenir a la lisiere du campement et de scruter l'obscurite.

Ce role n'a jamais ete purement technique. La sentinelle ne se contentait pas d'observer. La sentinelle interpretait. Un bruissement dans l'herbe pouvait etre le vent, un animal, ou un ennemi en approche. La difference entre ces trois interpretations n'etait pas une question de meilleurs capteurs. C'etait une question de connaissance accumulee sur ce champ precis, cette saison, ce schema de raids, le comportement attendu de cet ennemi. La valeur de la sentinelle ne residait pas dans son acuite visuelle. Elle residait dans son jugement, forge par le fait de vivre au sein d'un contexte qu'aucun etranger, aussi perspicace soit-il, ne pouvait reproduire a partir des seules donnees.

Quand on automatise la veille, on n'obtient pas une meilleure sentinelle. On obtient un capteur plus rapide. Ce n'est pas la meme chose.

Les analystes SOC sont les sentinelles du monde connecte. Et ce que les donnees d'Anthropic confirment discretement, c'est quelque chose que les anthropologues comprennent depuis des millenaires : le role de veilleur resiste a la mecanisation parce qu'il n'est pas fondamentalement une tache de perception. C'est une tache de construction de sens. La sentinelle ne se contente pas de voir. La sentinelle decide ce que cette vision signifie.

Et cette decision s'appuie sur des couches de connaissances culturelles, institutionnelles et experientielles qui ne peuvent etre extraites, serialisees et confiees a une machine.

Le probleme de la responsabilite dans la securite IA autonome

Il existe une autre dimension que le discours du "tout IA" ignore systematiquement.

Quand une decision de securite est erronee, quelqu'un en repond. Si une menace est ecartee et se transforme en violation de donnees, il y a une enquete. Il y a une chronologie. Il y a un humain dont le jugement est examine, remis en question et, si necessaire, tenu pour responsable. Ce n'est pas un defaut du systeme. C'est ainsi que la gouvernance de securite fonctionne. La chaine de responsabilite est ce qui fait fonctionner l'ensemble du dispositif.

Retirez l'humain de la boucle et vous ne perdez pas seulement le jugement. Vous perdez la responsabilite. Et un systeme de securite sans responsabilite n'est pas un systeme de securite. C'est un generateur de risques juridiques.

Toute societe confrontee a des decisions consequentes, des conseils tribaux aux tribunaux modernes, a compris que le poids d'une decision doit reposer sur une personne. Non parce que les personnes sont infaillibles, mais parce que le contrat social de responsabilite est ce qui confere a la decision sa legitimite. Un juge qui se trompe peut faire l'objet d'un appel. Un algorithme qui se trompe ne peut qu'etre patche. Ces deux situations ne sont pas equivalentes. L'une releve de la justice. L'autre de la maintenance.

Comment les organisations deploient reellement l'IA en securite

Avant de considerer ce chiffre de 2,4 % comme toute l'histoire, il convient de comprendre ce qui se passe a l'interieur des organisations qui utilisent effectivement l'IA dans leur pile de securite.

Les chiffres ne sont pas negligeables. En 2026, 77 % des organisations declarent utiliser l'IA generative ou de grands modeles de langage quelque part dans leurs operations de securite. Et 67 % ont deploye une forme d'IA agentique pour des taches de securite autonomes ou semi-autonomes. La technologie est presente. La question est de savoir comment elle est gouvernee.

La reponse est revelatrice : 70 % des organisations fonctionnent avec un modele humain dans la boucle. L'IA recommande. Une personne approuve. Seulement 14 % autorisent l'IA a prendre des actions de remediation independantes sans supervision humaine. Les organisations restantes se situent quelque part entre les deux, avec des niveaux variables d'automatisation encadres par des points de controle humains.

Ce n'est pas de la timidite. C'est de la discipline d'ingenierie. Les organisations automatisent la ou la precision est elevee et les consequences sont contenues. Blocage automatise des signatures de malwares connus. Mise en quarantaine automatisee des emails de phishing correspondant a des schemas etablis. Deploiement automatise de correctifs pour les vulnerabilites a faible risque. Ce sont les taches ou la boucle de retroaction est suffisamment serree pour que les machines operent de maniere independante.

Mais des qu'une decision touche des systemes critiques, des implications juridiques ou des donnees de menaces ambigues, l'humain reprend la main. Decisions de confinement affectant l'infrastructure de production. Revocations d'acces pour les comptes privilegies. Appels d'escalade declenchant des obligations de notification reglementaire. Ce sont les moments ou le cout d'une mauvaise decision automatisee depasse le cout d'attendre trente secondes qu'un humain examine la situation.

L'industrie n'a pas rejete l'IA. Elle a place l'IA exactement la ou elle doit etre : comme la couche la plus rapide dans une architecture de defense ou la couche la plus consequente reste humaine.

La realite des 84 % : combien de personnes utilisent vraiment l'IA ?

Prenons maintenant encore plus de recul.

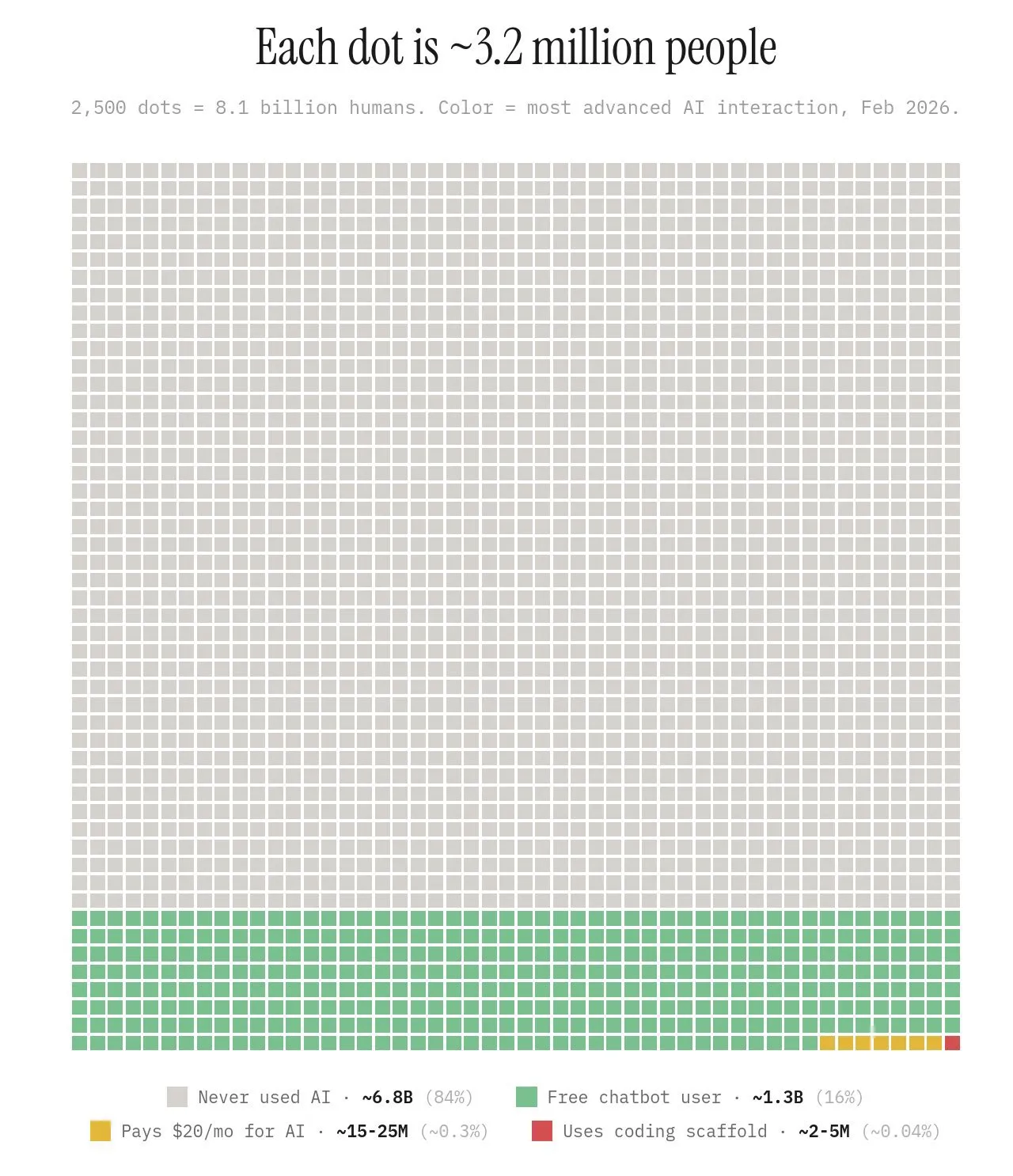

Une autre visualisation circule, une matrice de points representant la population mondiale entiere. 8,1 milliards de personnes. Chaque point represente 3,2 millions d'humains. Les couleurs racontent l'histoire :

- 84 % n'ont jamais utilise l'IA. 6,8 milliards de personnes qui n'ont jamais saisi un prompt.

- 16 % sont des utilisateurs gratuits de chatbots.

- Environ 0,3 % paient pour l'IA.

- Approximativement 0,04 %, soit entre 2 et 5 millions de personnes sur la planete entiere, utilisent des scaffolds de code.

L'ensemble de la conversation mondiale sur l'IA qui transforme tout est portee par l'experience de moins de 1 % de la population mondiale. Les professionnels de la securite qui deploient des agents IA, les ingenieurs qui construisent des defenses automatisees, les analystes dont les flux de travail ont ete restructures : ils representent une erreur d'arrondi dans l'histoire humaine.

Ce n'est pas un argument contre l'importance de l'IA. C'est un argument en faveur de la proportion. Quand quelqu'un dit "l'IA transforme la cybersecurite", il decrit un phenomene qui touche une tranche infime de l'humanite, discute par une tranche encore plus petite, et deploye par une tranche plus petite encore. L'urgence est peut-etre reelle. L'echelle de l'impact actuel n'est pas ce que le discours suggere.

Tout au long de l'histoire, les technologies transformatrices ont toujours ete racontees par la minorite infime qui les utilise en premier, creant une perception d'universalite qui ne correspond pas a la realite vecue par la plupart des gens. L'imprimerie changeait tout pendant des decennies avant que la plupart des Europeens n'aient tenu un livre entre les mains. L'electricite etait l'avenir alors que la majeure partie du monde cuisinait encore au feu de bois. Nous vivons a l'interieur de cette meme distorsion en ce moment, sauf que la vitesse du discours a depasse la vitesse de l'adoption par la marge la plus large jamais enregistree.

Ce que l'IA en cybersecurite signifie pour votre carriere

Si vous etudiez la cybersecurite, si vous y travaillez, ou si vous l'envisagez, voici le tableau honnete.

L'IA transformera vos outils. Le scan, l'analyse de logs, le triage initial, l'enumeration de vulnerabilites. Ces taches sont en cours d'automatisation et continueront de l'etre. Si votre projet est de passer une carriere a faire ce qu'un agent peut accomplir en quelques secondes, revoyez le plan.

L'IA ne remplacera pas votre role. Non parce que la technologie ne peut pas progresser. Elle progressera. Mais parce que la nature du probleme adversarial signifie que ce contre quoi on se defend utilise aussi l'IA. Cela cree une course aux armements ou le jugement humain n'est pas un goulet d'etranglement. Il est l'arbitre. L'attaquant dispose de l'IA. Le defenseur dispose de l'IA. La difference, c'est l'humain qui decide quoi faire de ce que l'IA fait remonter.

Les competences qui comptent evoluent. La revue manuelle de logs disparait. Le scan de vulnerabilites manuel est deja revolu. Ce qui croit, c'est la demande de professionnels capables d'interpreter les resultats generes par l'IA, de distinguer entre un systeme d'IA qui crie au loup et un systeme d'IA qui a decouvert quelque chose de reellement nouveau, de concevoir les politiques qui regissent ce que l'IA est autorisee a faire de maniere autonome et ou les points de controle humains doivent subsister. Le threat hunting, le leadership en reponse aux incidents, l'architecture de securite et la gouvernance de l'IA sont desormais les directions ou menent les parcours de carriere.

Notre espece a toujours eu besoin de ses sentinelles. Les outils qu'elles portent changent a chaque epoque. Le role, lui, ne change pas. La personne a la lisiere du campement, scrutant l'obscurite, decidant ce que signifient les formes. C'est un metier ancien. C'est aussi le votre.

Apprenez les outils. Utilisez les modeles. Automatisez ce qui peut l'etre. Mais construisez-vous autour de ce qui ne peut pas l'etre : le jugement, le contexte, la responsabilite, la volonte de vous tenir dans l'intervalle entre ce que la machine voit et ce que cela signifie.

C'est le metier. Les machines le rendent plus rapide. Elles ne le rendent pas inutile.

Elles ne le rendront jamais.

Fondateur d'Unihackers

Une décennie à défendre des compagnies aériennes, des SOC et des organisations internationales

Daute a fondé Unihackers après une décennie passée à défendre des compagnies aériennes, des SOC managés et des organisations internationales. Il est Associate C|CISO et voix régulière sur l'IA et la cybersécurité dans les médias internationaux. Silver Winner aux Cyber Security Excellence Awards 2021. Il enseigne comme il aurait voulu apprendre lui-même : sans bruit, sur ce que les attaquants font vraiment, pour former des professionnels utiles dès le premier jour.

Voir le profilPrêt à lancer votre carrière en cybersécurité ?

Rejoignez des centaines de professionnels qui se sont reconvertis en cybersécurité avec notre programme pratique.