IA nella Cybersecurity: Perché l'Umano nel Ciclo È l'Architettura, Non un Collo di Bottiglia

Solo il 2,4% dell'attivita degli agenti IA avviene nella cybersecurity. Perche l'umano nel ciclo resta il livello piu critico della sicurezza.

- Ai

- Industry

- Career

- Security Operations

- Thought Leadership

TL;DR

La ricerca 2026 di Anthropic sul deployment degli agenti IA rivela che la cybersecurity rappresenta solo il 2,4% di tutte le chiamate a strumenti degli agenti, mentre il software engineering domina al 49,7%. Non è un fallimento dell'adozione. È un segnale di maturità. La sicurezza è un dominio avversariale dove il giudizio umano comporta responsabilità, i segnali vengono deliberatamente manipolati, e la differenza tra un falso allarme e un'intrusione di uno stato-nazione dipende dall'esperienza, qualcosa che non può essere serializzato e consegnato a una macchina. L'umano nel ciclo non è una limitazione. È l'architettura.

Il Grafico Che Dovrebbe Sorprenderti

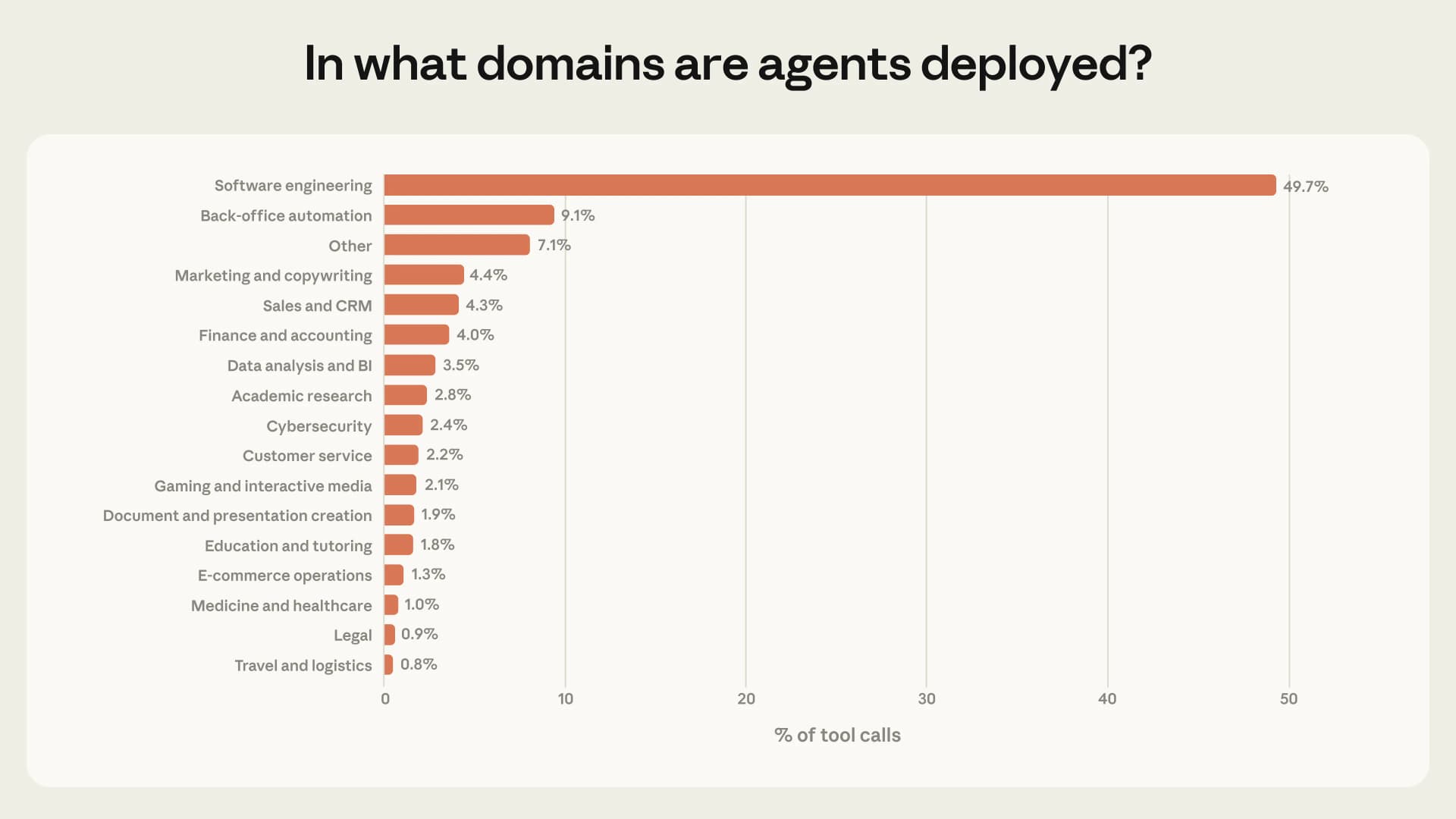

C'è un grafico che circola dalla più recente ricerca di Anthropic su come gli agenti IA vengono effettivamente impiegati nelle varie industrie. Il software engineering è in cima. 49,7% di tutte le chiamate a strumenti degli agenti. Quasi la metà. Sotto, la lista cala rapidamente: automazione del back office al 9,1%, marketing al 4,4%, analisi dati al 3,5%.

E poi, da qualche parte vicino al fondo, quasi facile da non notare: Cybersecurity. 2,4%.

Quel numero dovrebbe sorprenderti. Non perché la cybersecurity sia in qualche modo poco importante. È probabilmente il dominio con le conseguenze più gravi dell'intera lista. Ma perché il divario tra quanto l'IA viene usata nella sicurezza e quanto se ne parla nella sicurezza è enorme. Ogni conferenza, ogni presentazione di vendor, ogni post su LinkedIn promette threat detection guidata dall'IA, incident response autonoma, difesa alla velocità delle macchine.

Eppure, quando si guarda dove gli agenti stanno effettivamente lavorando, la cybersecurity a malapena si registra.

C'è una ragione per questo. E la ragione è più interessante del numero.

Perché la Cybersecurity Resiste all'Automazione IA

La cybersecurity non è come il software engineering.

Nel software engineering, il ciclo di feedback è pulito. Scrivi codice. Compila o non compila. I test passano o falliscono. L'output è abbastanza deterministico da permettere a un agente di iterare autonomamente: scrivere, testare, correggere, ripetere. Ecco perché quasi metà di tutta l'attività degli agenti si concentra lì. Il ciclo è stretto. Il segnale è chiaro.

La sicurezza non funziona così.

Nella sicurezza, il segnale è avversariale. Qualcuno sta attivamente cercando di rendere i dati fuorvianti. Il lavoro dell'attaccante è far sembrare la propria attività traffico normale, accesso legittimo, un'entry di log di routine.

Un agente IA può scansionare un milione di entry di log in pochi secondi. Questo è genuinamente utile. Ma decidere se l'anomalia nell'entry 847.321 è un servizio configurato male, un caso limite di routine o il primo indicatore di un'intrusione di uno stato-nazione richiede qualcosa che i modelli non hanno: giudizio situato.

Il tipo di giudizio che nasce da un analista umano che ha visto tre incidenti che iniziavano esattamente così. Che sa che quel particolare segmento di rete è stato ristrutturato martedì scorso. Che ricorda che lo stesso range di IP è comparso in un briefing sulle minacce due settimane fa. E che ha l'autorità istituzionale per escalare o archiviare sulla base di una sintesi di contesto a cui nessun modello può accedere, perché risiede nell'esperienza dell'analista, non nei dati.

Considerate cosa succede all'interno di un Security Operations Center alle 3 di notte. Una piattaforma SIEM segnala un pattern di movimento laterale tra due host interni. Il livello di triage IA lo classifica come severità media sulla base delle baseline storiche. Un analista junior seguirebbe il playbook: isolare, escalare, documentare. Ma l'analista senior di turno riconosce quei due host. Uno appartiene al team infrastruttura che sta eseguendo una migrazione autorizzata annunciata in un canale Slack tre giorni fa. L'altro è un server di staging che genera sempre traffico anomalo durante le finestre di deployment. Chiude il ticket in quaranta secondi. Nessun playbook copriva questo caso. Nessun modello aveva accesso al messaggio Slack, al calendario della migrazione, o alla memoria istituzionale di come appare il "normale" per quelle due macchine specifiche durante quella settimana specifica.

Questo è il giudizio situato. Ed è la ragione per cui la cybersecurity resiste al tipo di automazione end to end che funziona così bene per compilare codice o eseguire test di regressione.

La Sentinella: Un'Antropologia della Vigilanza Cyber

Ogni società umana che sia mai esistita ha avuto i suoi guardiani. Le sentinelle. Persone il cui ruolo non era costruire mura o coltivare i campi, ma stare ai confini dell'insediamento e guardare verso l'oscurità.

Questo ruolo non è mai stato puramente tecnico. La sentinella non si limitava a osservare. La sentinella interpretava. Un fruscio nell'erba poteva essere vento, un animale o un nemico in avvicinamento. La differenza tra queste tre interpretazioni non era questione di sensori migliori. Era questione di conoscenza accumulata su quel campo specifico, quella stagione, quel pattern di incursioni, il comportamento atteso di quel nemico. Il valore della sentinella non risiedeva nella sua vista. Risiedeva nel suo giudizio, forgiato dal vivere dentro un contesto che nessun estraneo, per quanto acuto, avrebbe potuto replicare partendo solo dai dati.

Quando automatizziamo la sorveglianza, non otteniamo una sentinella migliore. Otteniamo un sensore più veloce. Non sono la stessa cosa.

Gli analisti SOC sono le sentinelle del mondo interconnesso. E ciò che i dati di Anthropic stanno silenziosamente confermando è qualcosa che gli antropologi comprendono da millenni: il ruolo della sorveglianza resiste alla meccanizzazione perché non è fondamentalmente un compito di percezione. È un compito di attribuzione di significato. La sentinella non si limita a vedere. La sentinella decide cosa significa ciò che vede.

E quella decisione attinge a strati di conoscenza culturale, istituzionale ed esperienziale che non possono essere estratti, serializzati e consegnati a una macchina.

Il Problema della Responsabilità con l'IA Autonoma nella Sicurezza

C'è un'altra dimensione che la narrativa "IA ovunque" ignora costantemente.

Quando una decisione di sicurezza è sbagliata, qualcuno ne risponde. Se una minaccia viene archiviata e si trasforma in un data breach, si apre un'indagine. C'è una timeline. C'è un essere umano il cui giudizio viene riesaminato, messo in discussione e, se necessario, chiamato a renderne conto. Non è un bug del sistema. È così che funziona la governance della sicurezza. La catena di responsabilità è ciò che fa funzionare l'intero sistema.

Rimuovi l'umano dal ciclo e non perdi solo il giudizio. Perdi la responsabilità. E un sistema di sicurezza senza responsabilità non è un sistema di sicurezza. È un generatore di responsabilità legali.

Ogni società che abbia affrontato decisioni con conseguenze importanti, dai consigli tribali ai tribunali moderni, ha compreso che il peso di una decisione deve ricadere su una persona. Non perché le persone siano infallibili, ma perché il contratto sociale della responsabilità è ciò che conferisce legittimità alla decisione. Un giudice che sbaglia può essere appellato. Un algoritmo che sbaglia può solo essere aggiornato. Non sono equivalenti. Uno è giustizia. L'altro è manutenzione.

Come le Organizzazioni Deployano Davvero l'IA nella Sicurezza

Prima di liquidare quel 2,4% come l'intera storia, vale la pena capire cosa sta succedendo all'interno delle organizzazioni che stanno usando l'IA nel proprio stack di sicurezza.

I numeri non sono piccoli. Nel 2026, il 77% delle organizzazioni dichiara di usare IA generativa o modelli linguistici di grandi dimensioni da qualche parte nelle proprie operazioni di sicurezza. E il 67% ha deployato qualche forma di IA agentica per attività di sicurezza autonome o semi-autonome. La tecnologia è presente. La domanda è come viene governata.

La risposta è rivelatrice: il 70% delle organizzazioni adotta un modello con umano nel ciclo. L'IA raccomanda. Una persona approva. Solo il 14% consente all'IA di intraprendere azioni di remediation indipendenti senza supervisione umana. Le organizzazioni restanti si collocano in una posizione intermedia, con livelli variabili di automazione subordinati a checkpoint umani.

Non è timidezza. È disciplina ingegneristica. Le organizzazioni automatizzano dove la precisione è alta e le conseguenze sono contenute. Blocco automatico di firme malware note. Quarantena automatica di email di phishing che corrispondono a pattern consolidati. Deployment automatico di patch per vulnerabilità a basso rischio. Questi sono i compiti dove il ciclo di feedback è abbastanza stretto perché le macchine operino in autonomia.

Ma nel momento in cui una decisione tocca sistemi critici, implicazioni legali o dati di minaccia ambigui, l'umano rientra in gioco. Decisioni di contenimento che impattano l'infrastruttura di produzione. Revoche di accesso per account privilegiati. Chiamate di escalation che innescano requisiti di notifica regolamentare. Questi sono i momenti in cui il costo di una decisione automatizzata sbagliata supera il costo di attendere trenta secondi perché un umano la riveda.

L'industria non ha rifiutato l'IA. Ha collocato l'IA esattamente dove appartiene: come il livello più veloce in un'architettura di difesa dove il livello con le conseguenze più gravi resta umano.

La Realtà dell'84%: Quante Persone Usano Davvero l'IA?

Ora allarghiamo ulteriormente lo sguardo.

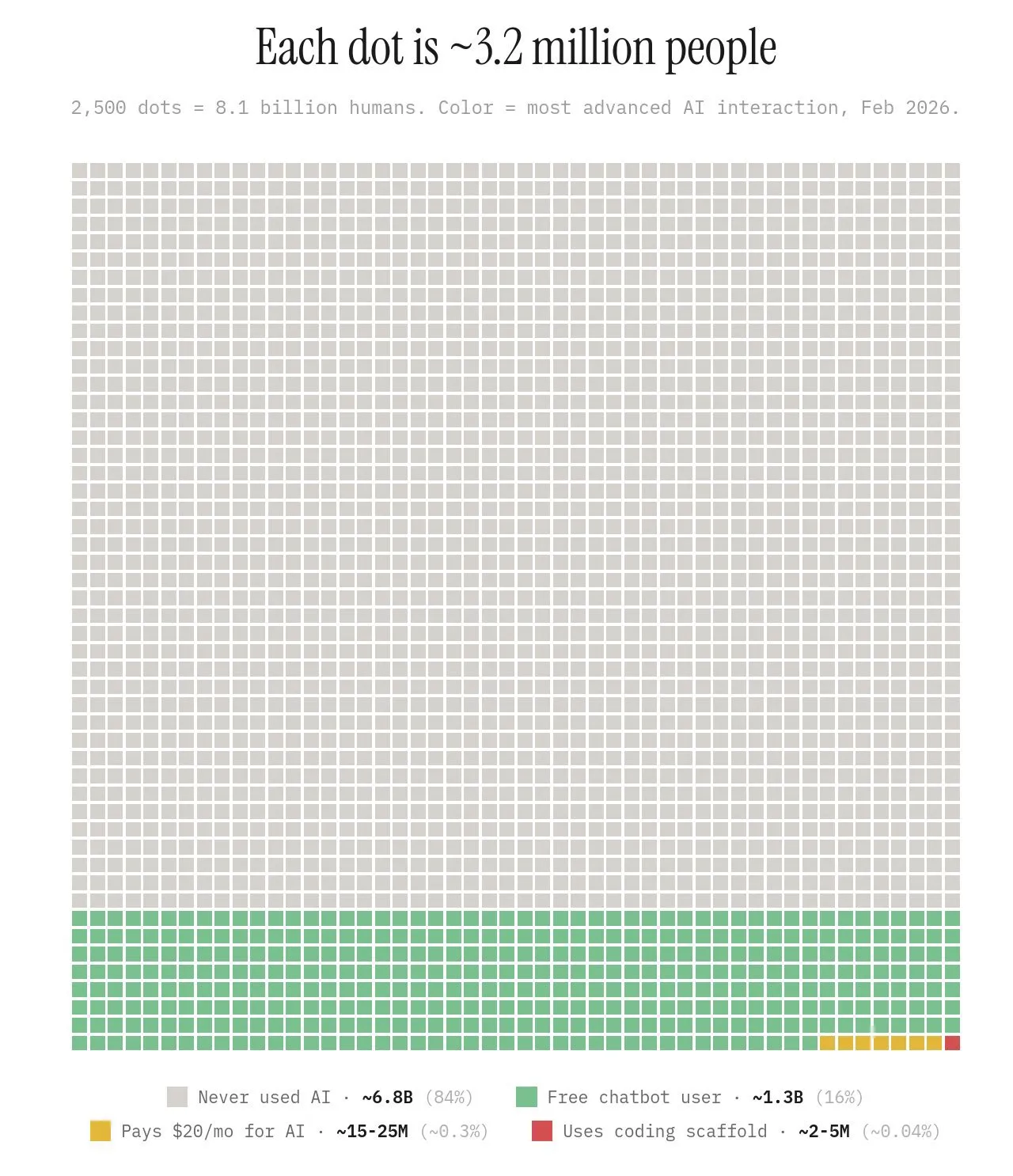

C'è un'altra visualizzazione che circola, una matrice a punti che rappresenta l'intera popolazione mondiale. 8,1 miliardi di persone. Ogni punto rappresenta 3,2 milioni di esseri umani. I colori raccontano la storia:

- L'84% non ha mai usato l'IA. 6,8 miliardi di persone che non hanno mai digitato un prompt.

- Il 16% usa chatbot gratuiti.

- Circa lo 0,3% paga per l'IA.

- Approssimativamente lo 0,04%, tra i 2 e i 5 milioni di persone sull'intero pianeta, usa strumenti di coding assistito.

L'intera conversazione globale sull'IA che trasforma tutto è guidata dall'esperienza di meno dell'1% della popolazione mondiale. I professionisti della sicurezza che deployano agenti IA, gli ingegneri che costruiscono difese automatizzate, gli analisti i cui flussi di lavoro sono stati ristrutturati, sono un errore di arrotondamento nella storia umana.

Questo non è un argomento contro l'importanza dell'IA. È un argomento a favore della proporzione. Quando qualcuno dice "l'IA sta cambiando la cybersecurity", sta descrivendo un fenomeno che riguarda una fetta infinitesimale dell'umanità, discusso da una fetta ancora più piccola, e deployato da una fetta ancora più piccola. L'urgenza potrebbe essere reale. La portata dell'impatto attuale non è quella che la narrativa suggerisce.

Nel corso della storia, le tecnologie trasformative sono sempre state narrate dalla minuscola minoranza che le usa per prima, creando una percezione di universalità che non corrisponde alla realtà vissuta dalla maggior parte delle persone. La stampa stava cambiando tutto da decenni prima che la maggior parte degli europei avesse tenuto in mano un libro. L'elettricità era il futuro mentre la maggior parte del mondo cucinava ancora sul fuoco. Stiamo vivendo dentro la stessa distorsione proprio adesso, con la differenza che la velocità della narrativa ha superato la velocità dell'adozione con il margine più ampio della storia documentata.

Cosa Significa l'IA nella Cybersecurity per la Tua Carriera

Se stai studiando cybersecurity, o ci lavori, o la stai valutando, ecco il quadro onesto.

L'IA cambierà i tuoi strumenti. Le scansioni, l'analisi dei log, il triage iniziale, l'enumerazione delle vulnerabilità. Tutto questo viene automatizzato e continuerà ad esserlo. Se il tuo piano è passare una carriera a fare ciò che un agente può fare in pochi secondi, rivedi il piano.

L'IA non sostituirà il tuo ruolo. Non perché la tecnologia non possa migliorare. Migliorerà. Ma perché la natura del problema avversariale implica che anche ciò da cui ci si difende usa l'IA. Questo crea una corsa agli armamenti dove il giudizio umano non è un collo di bottiglia. È l'elemento decisivo. L'attaccante ha l'IA. Il difensore ha l'IA. La differenza è l'umano che decide cosa fare con ciò che l'IA porta in superficie.

Le competenze che contano stanno cambiando. La revisione manuale dei log sta scomparendo. La scansione manuale delle vulnerabilità è già superata. Ciò che cresce è la domanda di professionisti capaci di interpretare i risultati generati dall'IA, che sappiano distinguere tra un sistema IA che grida al lupo e un sistema IA che ha trovato qualcosa di genuinamente inedito, che sappiano progettare le policy che governano ciò che l'IA può fare in autonomia e dove i gate umani devono restare. Threat hunting, leadership nell'incident response, architettura di sicurezza e governance dell'IA sono le direzioni verso cui portano i percorsi di carriera oggi.

La nostra specie ha sempre avuto bisogno delle sue sentinelle. Gli strumenti che portano cambiano con ogni epoca. Il ruolo no. La persona ai confini dell'insediamento, che guarda nell'oscurità, che decide cosa significano quelle sagome. Quello è un mestiere antico. È anche il tuo.

Impara gli strumenti. Usa i modelli. Automatizza ciò che può essere automatizzato. Ma costruisci te stesso attorno alla parte che non può esserlo: il giudizio, il contesto, la responsabilità, la volontà di stare nello spazio tra ciò che la macchina vede e ciò che significa.

Questo è il mestiere. Le macchine lo rendono più veloce. Non lo rendono superfluo.

Non lo faranno mai.

Fondatore di Unihackers

Un decennio a difendere compagnie aeree, SOC e organizzazioni internazionali

Daute ha fondato Unihackers dopo un decennio passato a difendere compagnie aeree, SOC gestiti e organizzazioni internazionali. È Associate C|CISO e voce ricorrente su IA e cybersecurity nei media internazionali. Silver Winner ai Cyber Security Excellence Awards 2021. Insegna come avrebbe voluto che insegnassero a lui: senza rumore, su quello che fanno davvero gli attaccanti, formando professionisti utili dal primo giorno.

Vedi profiloPronto ad iniziare la tua carriera nella cybersecurity?

Unisciti a centinaia di professionisti che sono passati alla cybersecurity con il nostro programma pratico.