KI in der Cybersicherheit: Warum der Mensch in der Schleife die Architektur ist, nicht der Engpass

Nur 2,4 % der KI-Agenten-Aktivität entfaellt auf Cybersicherheit. Warum der Mensch in der Schleife die wichtigste Sicherheitsebene bleibt.

- Ai

- Industry

- Career

- Security Operations

- Thought Leadership

TL;DR

Anthropics Forschung 2026 zum Einsatz von KI-Agenten zeigt: Cybersicherheit macht nur 2,4 % aller Agenten-Tool-Aufrufe aus, während Softwareentwicklung mit 49,7 % dominiert. Das ist kein Adoptionsversagen. Es ist ein Zeichen von Reife. Sicherheit ist ein adversariales Feld, in dem menschliches Urteilsvermögen Verantwortung trägt, Signale gezielt manipuliert werden und der Unterschied zwischen einem Fehlalarm und dem Einbruch eines Nationalstaats auf Erfahrung beruht, die sich nicht serialisieren und einer Maschine übergeben lässt. Der Mensch in der Schleife ist keine Einschränkung. Er ist die Architektur.

Die Grafik, die Sie überraschen sollte

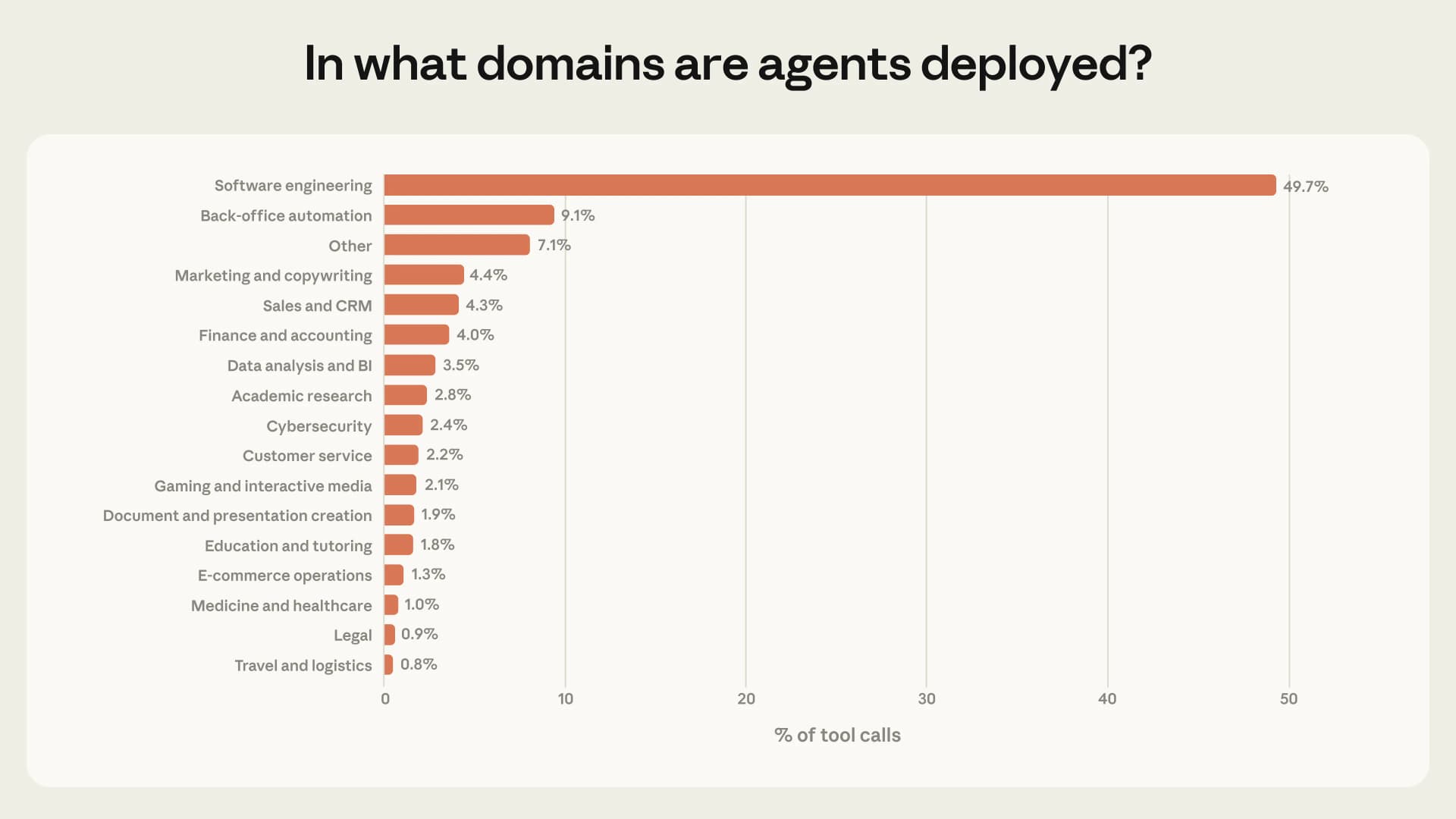

Eine Grafik aus Anthropics aktueller Forschung macht gerade die Runde. Sie zeigt, wie KI-Agenten tatsächlich in verschiedenen Branchen eingesetzt werden. Softwareentwicklung steht ganz oben. 49,7 % aller Agenten-Tool-Aufrufe. Fast die Hälfte. Darunter fällt die Liste steil ab: Back-Office-Automatisierung mit 9,1 %, Marketing mit 4,4 %, Datenanalyse mit 3,5 %.

Und dann, irgendwo weit unten, fast leicht zu übersehen: Cybersicherheit. 2,4 %.

Diese Zahl sollte Sie überraschen. Nicht, weil Cybersicherheit unwichtig wäre. Sie ist wohl der folgenreichste Bereich auf der gesamten Liste. Sondern weil die Kluft zwischen dem, wie viel KI in der Sicherheit genutzt wird, und dem, wie viel darüber geredet wird, enorm ist. Jede Konferenz, jeder Hersteller-Pitch, jeder LinkedIn-Post verspricht KI-gesteuerte Bedrohungserkennung, autonome Incident Response, Verteidigung in Maschinengeschwindigkeit.

Und doch: Wenn man sich ansieht, wo Agenten tatsächlich arbeiten, taucht Cybersicherheit kaum auf.

Dafür gibt es einen Grund. Und der Grund ist interessanter als die Zahl.

Warum sich Cybersicherheit gegen KI-Automatisierung sperrt

Cybersicherheit ist nicht wie Softwareentwicklung.

In der Softwareentwicklung ist die Feedback-Schleife sauber. Man schreibt Code. Er kompiliert oder nicht. Tests bestehen oder scheitern. Das Ergebnis ist deterministisch genug, dass ein Agent autonom iterieren kann: schreiben, testen, korrigieren, wiederholen. Deshalb liegt fast die Hälfte aller Agenten-Aktivität dort. Die Schleife ist eng. Das Signal ist klar.

In der Sicherheit funktioniert das nicht.

In der Sicherheit ist das Signal adversarial. Jemand versucht aktiv, die Daten in die Irre zu führen. Die gesamte Aufgabe des Angreifers besteht darin, seine Aktivität wie normalen Traffic aussehen zu lassen, wie legitimen Zugriff, wie einen routinemäßigen Log-Eintrag.

Ein KI-Agent kann eine Million Log-Einträge in Sekunden durchsuchen. Das ist tatsächlich nützlich. Aber die Entscheidung, ob die Anomalie in Eintrag 847.321 ein fehlkonfigurierter Dienst, ein routinemäßiger Grenzfall oder der erste Indikator eines nationalstaatlichen Eindringens ist, erfordert etwas, das Modelle nicht haben: situiertes Urteilsvermögen.

Die Art von Urteilsvermögen, die von einem menschlichen Analysten kommt, der drei Vorfälle gesehen hat, die genau so begannen. Der weiß, dass dieses spezifische Netzwerksegment letzten Dienstag umstrukturiert wurde. Der sich erinnert, dass derselbe IP-Bereich vor zwei Wochen in einem Threat Briefing auftauchte. Und der die institutionelle Autorität besitzt, zu eskalieren oder zu verwerfen, basierend auf einer Synthese von Kontext, auf den kein Modell zugreifen kann, weil er in der Erfahrung des Analysten lebt, nicht in den Daten.

Stellen Sie sich vor, was in einem Security Operations Center um 3 Uhr morgens passiert. Eine SIEM-Plattform meldet ein Lateral-Movement-Muster zwischen zwei internen Hosts. Die KI-Triage-Schicht bewertet es anhand historischer Baselines als mittlere Schwere. Ein Junior-Analyst würde dem Playbook folgen: isolieren, eskalieren, dokumentieren. Doch die erfahrene Analystin in der Schicht erkennt die beiden Hosts. Einer gehört dem Infrastruktur-Team, das eine genehmigte Migration durchführt, die vor drei Tagen in einem Slack-Kanal angekündigt wurde. Der andere ist ein Staging-Server, der während Deployment-Fenstern immer anomalen Traffic erzeugt. Sie schließt das Ticket in vierzig Sekunden. Kein Playbook hatte diesen Fall abgedeckt. Kein Modell hatte Zugriff auf die Slack-Nachricht, den Migrationsplan oder das institutionelle Gedächtnis davon, wie "normal" für diese beiden bestimmten Maschinen in dieser bestimmten Woche aussieht.

Das ist situiertes Urteilsvermögen. Und es ist der Grund, warum sich Cybersicherheit gegen die Art von durchgängiger Automatisierung sperrt, die beim Kompilieren von Code oder beim Ausführen von Regressionstests so gut funktioniert.

Der Wächter: Eine Anthropologie der Cybersicherheits-Wachsamkeit

Jede menschliche Gesellschaft, die je existiert hat, hatte Wächter. Posten. Menschen, deren Aufgabe es nicht war, Mauern zu bauen oder Felder zu bestellen, sondern am Rand der Siedlung zu stehen und hinaus in die Dunkelheit zu blicken.

Diese Rolle war nie rein technisch. Der Wächter beobachtete nicht einfach. Der Wächter interpretierte. Ein Rascheln im Gras konnte Wind sein, ein Tier oder ein sich nähernder Feind. Der Unterschied zwischen diesen drei Interpretationen war keine Frage besserer Sensoren. Es war eine Frage angesammelten Wissens über dieses bestimmte Feld, diese Jahreszeit, dieses Muster von Überfällen, das zu erwartende Verhalten dieses Feindes. Der Wert des Wächters lag nicht in seinen Augen. Er lag in seinem Urteilsvermögen, geschärft durch das Leben in einem Kontext, den kein Außenstehender, egal wie aufmerksam, allein aus Daten replizieren konnte.

Wenn wir das Wachen automatisieren, bekommen wir keinen besseren Wächter. Wir bekommen einen schnelleren Sensor. Das ist nicht dasselbe.

SOC-Analysten sind die Wächter der vernetzten Welt. Und was Anthropics Daten leise bestätigen, ist etwas, das Anthropologen seit Jahrtausenden verstehen: Die Wächterrolle widersteht der Mechanisierung, weil sie im Kern keine Wahrnehmungsaufgabe ist. Sie ist eine Aufgabe der Bedeutungsfindung. Der Wächter sieht nicht nur. Der Wächter entscheidet, was das Gesehene bedeutet.

Und diese Entscheidung schöpft aus Schichten kulturellen, institutionellen und erfahrungsbasierten Wissens, die sich nicht extrahieren, serialisieren und einer Maschine übergeben lassen.

Das Verantwortungsproblem autonomer KI-Sicherheit

Es gibt eine weitere Dimension, die das Narrativ vom "KI überall" konsequent ignoriert.

Wenn eine Sicherheitsentscheidung falsch ist, muss jemand dafür geradestehen. Wenn eine Bedrohung abgetan wird und sich in ein Datenleck verwandelt, gibt es eine Untersuchung. Es gibt eine Zeitleiste. Es gibt einen Menschen, dessen Urteilsvermögen überprüft, hinterfragt und, falls nötig, zur Rechenschaft gezogen wird. Das ist kein Fehler im System. So funktioniert Sicherheits-Governance. Die Verantwortungskette ist es, die das gesamte System funktionsfähig macht.

Entfernt man den Menschen aus der Schleife, verliert man nicht nur Urteilsvermögen. Man verliert Verantwortlichkeit. Und ein Sicherheitssystem ohne Verantwortlichkeit ist kein Sicherheitssystem. Es ist ein Haftungsrisiko-Generator.

Jede Gesellschaft, die mit folgenreichen Entscheidungen umgehen musste, von Stammesräten bis zu modernen Gerichten, hat verstanden, dass das Gewicht einer Entscheidung auf einer Person ruhen muss. Nicht weil Menschen unfehlbar sind, sondern weil der Gesellschaftsvertrag der Verantwortlichkeit der Entscheidung erst Legitimität verleiht. Ein Richter, der falsch urteilt, kann in Berufung gehen. Ein Algorithmus, der falsch urteilt, kann nur gepatcht werden. Das ist nicht äquivalent. Das eine ist Rechtsprechung. Das andere ist Wartung.

Wie Organisationen KI in der Sicherheit tatsächlich einsetzen

Bevor man die 2,4 % als die ganze Geschichte abtut, lohnt es sich zu verstehen, was innerhalb der Organisationen passiert, die KI tatsächlich in ihrem Security-Stack einsetzen.

Die Zahlen sind nicht klein. 2026 berichten 77 % der Organisationen, generative KI oder Large Language Models irgendwo in ihrem Sicherheitsbetrieb einzusetzen. Und 67 % haben eine Form von agentischer KI für autonome oder semi-autonome Sicherheitsaufgaben implementiert. Die Technologie ist vorhanden. Die Frage ist, wie sie gesteuert wird.

Die Antwort ist aufschlussreich: 70 % der Organisationen betreiben ein Human-in-the-Loop-Modell. KI empfiehlt. Ein Mensch genehmigt. Nur 14 % erlauben der KI, unabhängige Gegenmaßnahmen ohne menschliche Aufsicht zu ergreifen. Die übrigen Organisationen bewegen sich irgendwo dazwischen, mit unterschiedlichen Automatisierungsgraden, die hinter menschlichen Kontrollpunkten geschaltet sind.

Das ist keine Zaghaftigkeit. Das ist Ingenieurdisziplin. Organisationen automatisieren dort, wo die Präzision hoch und die Konsequenzen begrenzt sind. Automatisches Blockieren bekannter Malware-Signaturen. Automatische Quarantäne von Phishing-E-Mails, die etablierten Mustern entsprechen. Automatisches Patch-Deployment für Schwachstellen mit geringem Risiko. Das sind die Aufgaben, bei denen die Feedback-Schleife eng genug ist, damit Maschinen eigenständig arbeiten können.

Doch sobald eine Entscheidung kritische Systeme, rechtliche Implikationen oder mehrdeutige Bedrohungsdaten berührt, tritt der Mensch wieder ein. Eindämmungsentscheidungen, die Produktionsinfrastruktur betreffen. Zugriffsentzug für privilegierte Konten. Eskalationsentscheidungen, die regulatorische Meldepflichten auslösen. Das sind die Momente, in denen die Kosten einer falschen automatisierten Entscheidung die Kosten übersteigen, dreißig Sekunden auf eine menschliche Überprüfung zu warten.

Die Branche hat KI nicht abgelehnt. Sie hat KI genau dort platziert, wo sie hingehört: als schnellste Schicht in einer Verteidigungsarchitektur, deren folgenreichste Schicht menschlich bleibt.

Die 84-Prozent-Realität: Wie viele Menschen nutzen tatsächlich KI?

Jetzt zoomen wir weiter heraus.

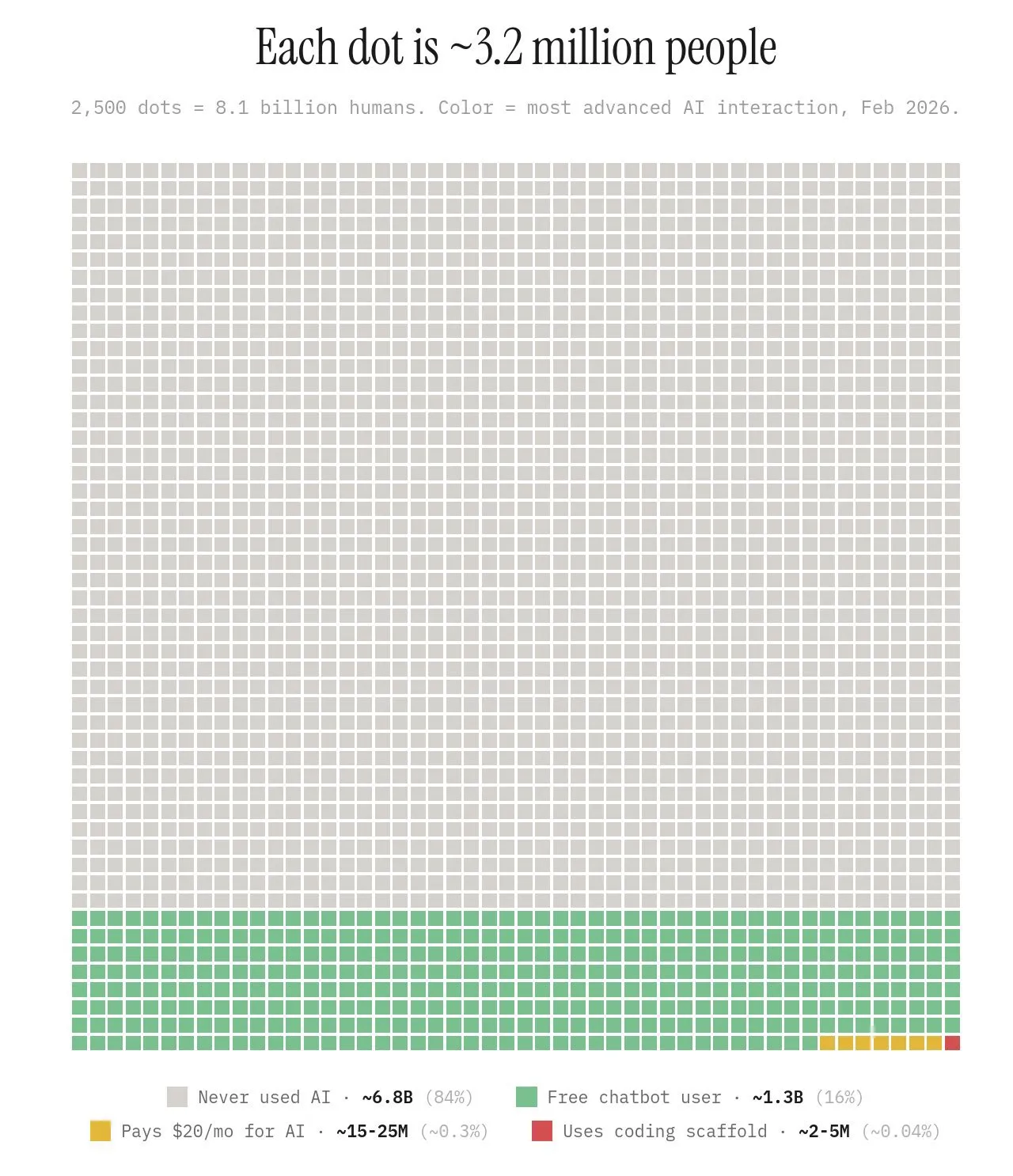

Es gibt eine weitere Visualisierung, die gerade kursiert: eine Punktmatrix, die die gesamte Weltbevölkerung darstellt. 8,1 Milliarden Menschen. Jeder Punkt steht für 3,2 Millionen Menschen. Die Farben erzählen die Geschichte:

- 84 % haben noch nie KI genutzt. 6,8 Milliarden Menschen, die noch nie einen Prompt eingegeben haben.

- 16 % sind kostenlose Chatbot-Nutzer.

- Etwa 0,3 % bezahlen für KI.

- Ungefähr 0,04 %, irgendwo zwischen 2 und 5 Millionen Menschen auf dem gesamten Planeten, nutzen Coding-Scaffolds.

Die gesamte globale Diskussion darüber, dass KI alles transformiert, wird von den Erfahrungen weniger als 1 % der Weltbevölkerung angetrieben. Die Sicherheitsfachleute, die KI-Agenten einsetzen, die Ingenieure, die automatisierte Verteidigung bauen, die Analysten, deren Arbeitsabläufe umstrukturiert wurden, sie sind ein Rundungsfehler in der menschlichen Geschichte.

Das ist kein Argument gegen die Bedeutung von KI. Es ist ein Argument für Verhältnismäßigkeit. Wenn jemand sagt "KI verändert die Cybersicherheit", beschreibt er ein Phänomen, das einen verschwindend kleinen Bruchteil der Menschheit betrifft, von einem noch kleineren Bruchteil diskutiert wird und von einem noch kleineren eingesetzt wird. Die Dringlichkeit mag real sein. Das Ausmaß der tatsächlichen Auswirkungen ist nicht das, was das Narrativ suggeriert.

Im Lauf der Geschichte wurden transformative Technologien immer von der winzigen Minderheit erzählt, die sie zuerst nutzte, und erzeugten eine Wahrnehmung von Allgegenwart, die nicht der gelebten Realität der meisten Menschen entsprach. Der Buchdruck veränderte alles, jahrzehntelang bevor die meisten Europäer ein Buch in der Hand gehalten hatten. Elektrizität war die Zukunft, während der Großteil der Welt noch über offenem Feuer kochte. Wir leben gerade in genau dieser Verzerrung, nur dass die Geschwindigkeit des Narrativs die Geschwindigkeit der Adoption mit dem größten Abstand der aufgezeichneten Geschichte überholt hat.

Was KI in der Cybersicherheit für Ihre Karriere bedeutet

Wenn Sie Cybersicherheit studieren, darin arbeiten oder es in Betracht ziehen, hier ist das ehrliche Bild.

KI wird Ihre Werkzeuge verändern. Das Scanning, die Log-Analyse, die Ersttriage, die Schwachstellenerfassung. Das wird automatisiert und wird weiter automatisiert werden. Wenn Ihr Plan ist, eine Karriere damit zu verbringen, was ein Agent in Sekunden erledigen kann, überdenken Sie den Plan.

KI wird Ihre Rolle nicht ersetzen. Nicht, weil die Technologie sich nicht verbessern kann. Das wird sie. Sondern weil die Natur des adversarialen Problems bedeutet, dass das, wogegen verteidigt wird, ebenfalls KI nutzt. Das erzeugt ein Wettrüsten, bei dem menschliches Urteilsvermögen kein Engpass ist. Es ist der Tiebreaker. Der Angreifer hat KI. Der Verteidiger hat KI. Den Unterschied macht der Mensch, der entscheidet, was mit dem anzufangen ist, was die KI zutage fördert.

Die gefragten Fähigkeiten verschieben sich. Routinemäßige Log-Auswertung verschwindet. Manuelles Schwachstellen-Scanning ist bereits Geschichte. Was wächst, ist die Nachfrage nach Fachleuten, die KI-generierte Ergebnisse interpretieren können, die unterscheiden können, ob ein KI-System falschen Alarm schlägt oder ob es tatsächlich etwas Neuartiges gefunden hat, die die Richtlinien entwerfen können, die festlegen, was KI autonom tun darf und wo menschliche Kontrollpunkte bestehen bleiben müssen. Threat Hunting, Incident-Response-Führung, Sicherheitsarchitektur und KI-Governance sind die Richtungen, in die die Karrierepfade heute führen.

Unsere Spezies hat immer ihre Wächter gebraucht. Die Werkzeuge, die sie tragen, ändern sich mit jeder Epoche. Die Rolle nicht. Die Person am Rand der Siedlung, die in die Dunkelheit blickt und entscheidet, was die Umrisse bedeuten. Das ist ein uralter Beruf. Es ist auch Ihrer.

Lernen Sie die Werkzeuge. Nutzen Sie die Modelle. Automatisieren Sie, was automatisierbar ist. Aber bauen Sie sich selbst um den Teil herum auf, der es nicht ist: das Urteilsvermögen, den Kontext, die Verantwortung, die Bereitschaft, in der Lücke zwischen dem zu stehen, was die Maschine sieht, und dem, was es bedeutet.

Das ist der Beruf. Die Maschinen machen ihn schneller. Sie machen ihn nicht überflüssig.

Das werden sie nie.

Gründer von Unihackers

Ein Jahrzehnt im Schutz von Fluggesellschaften, SOCs und internationalen Organisationen

Daute hat Unihackers nach einem Jahrzehnt im Schutz von Fluggesellschaften, Managed SOCs und internationalen Organisationen gegründet. Er ist Associate C|CISO und feste Stimme zu KI und Cybersicherheit in internationalen Medien. Silver Winner bei den Cyber Security Excellence Awards 2021. Er unterrichtet so, wie er selbst gerne unterrichtet worden wäre: ohne Lärm, anhand dessen, was Angreifer wirklich tun, und mit Absolventen, die ab Tag eins nützlich sind.

Profil ansehenBereit, Ihre Cybersecurity-Karriere zu starten?

Schließen Sie sich Hunderten von Fachleuten an, die mit unserem praxisorientierten Bootcamp in die Cybersecurity gewechselt sind.